NSSpeechSynthesizer

NSSpeechSynthesizer класс является интерфейсом Cocoa к Синтезу речи на OS X. Экземпляры этого класса вызывают синтезаторами речи.

Синтез речи, также названный синтезом речи по тексту (TTS), анализирует текст и преобразовывает его в слышимую речь. Это предлагает параллельный режим обратной связи, который может использоваться совместно с или вместо традиционных визуальных и слуховых уведомлений. Например, Ваше приложение может использовать NSSpeechSynthesizer объект «объявить» текст важных предупредительных диалоговых окон. Синтезированная речь имеет несколько преимуществ. Это может предоставить срочную информацию пользователям, не вынуждая их сместить внимание от их текущей задачи. И потому что речь не полагается на визуальные элементы для значения, это - решающая технология для пользователей с ограниченными возможностями внимания или видением.

Кроме того, синтезированная речь может помочь сохранить системные ресурсы. Поскольку звуковые выборки могут привести большие суммы в рабочее состояние комнаты на диске, использование текста вместо выбранного звука чрезвычайно эффективно, и таким образом, мультимедийное приложение могло бы использовать NSSpeechSynthesizer объект обеспечить повествование фильма в формате QuickTime вместо того, чтобы включить данные выбранного звука на дорожке фильма.

Когда Вы создаете NSSpeechSynthesizer экземпляр с помощью инициализатора по умолчанию (init), класс использует речь по умолчанию, выбранную в Установках системы> Речь. Также можно выбрать определенную речь для NSSpeechSynthesizer экземпляр путем инициализации его с initWithVoice:. Для начала синтеза отправьте также startSpeakingString: или startSpeakingString:toURL: к экземпляру. Прежний генерирует речь через устройство звукового вывода системы по умолчанию; последний сохраняет сгенерированную речь в файле. Если Вы хотите быть уведомленными, когда текущая речь заканчивается, установите delegate свойство и реализация метод делегата speechSynthesizer:didFinishSpeaking:.

Синтез речи является только одной из речевых технологий OS X. Технология Устройства распознавания речи позволяет приложениям «слушать» текст, на котором говорят на английском языке США; NSSpeechRecognizer класс является интерфейсом Cocoa к этой технологии. Обе технологии предоставляют преимущества для всех пользователей и особенно полезны для тех пользователей, испытывающих затруднения при наблюдении экрана или использовании мыши и клавиатуры.

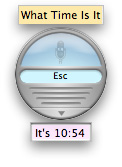

Речевое окно обратной связи

Речевое окно обратной связи (рисунок 1) выводит на экран текст, распознанный от речи пользователя и текста от который NSSpeechSynthesizer объект синтезирует речь. Используя обратную связь окно делает разговорный обмен более естественным и помогает пользователю понять синтезированную речь.

Например, Ваше приложение может использовать NSSpeechRecognizer объект прислушаться к команде «Play some music». Когда это распознает эту команду, Ваше приложение могло бы тогда ответить путем разговора “Который художник?” использование синтезатора речи.

Когда UsesFeedbackWindow YEStrue, синтезатор речи использует окно обратной связи, если ее видимое, которое пользователь указывает в Установках системы> Речь.

Оператор импорта

Swift

import AppKit

Objective C

@import AppKit;

Доступность

Доступный в OS X v10.3 и позже.

-

Инициализирует получатель с речью.

Объявление

Swift

init!(voicevoiceIdentifier: String?)Objective C

- (instancetype)initWithVoice:(NSString *)voiceIdentifierПараметры

voiceIdentifierИдентификатор речи для установки как текущая речь. Когда

nil, речь по умолчанию используется. Передача определенной речью означает, что начальный говорящий курс установлен говорящим уровнем синтезатора по умолчанию; передачаnilозначает, что говорящий уровень автоматически установлен в уровень, который пользователь указывает в Речевых предпочтениях.Возвращаемое значение

Инициализированный синтезатор речи или

nilкогда речь, идентифицированнаяvoiceIdentifierкогда существует ошибка выделения, не доступно или.Оператор импорта

Objective C

@import AppKit;Swift

import AppKitДоступность

Доступный в OS X v10.3 и позже.

См. также

-

usesFeedbackWindow usesFeedbackWindowСвойствоУказывает, использует ли получатель речевое окно обратной связи.

Объявление

Swift

var usesFeedbackWindow: BoolObjective C

@property BOOL usesFeedbackWindowОбсуждение

YEStrueкогда получатель использует речевое окно обратной связи,NOfalseиначе.См. описание класса для подробных данных о

UsesFeedbackWindowатрибут.Оператор импорта

Objective C

@import AppKit;Swift

import AppKitДоступность

Доступный в OS X v10.3 и позже.

См. также

-

Возвращает идентификатор текущей речи получателя.

Возвращаемое значение

Идентификатор текущей речи получателя.

Оператор импорта

Objective C

@import AppKit;Swift

import AppKitДоступность

Доступный в OS X v10.3 и позже.

См. также

-

Устанавливает текущую речь получателя.

Объявление

Swift

func setVoice(_voiceIdentifier: String?) -> BoolObjective C

- (BOOL)setVoice:(NSString *)voiceIdentifierПараметры

voiceIdentifierИдентификатор речи для установки в текущей речи получателя. Когда

nil, получатель устанавливает речь по умолчанию как свою текущую речь.Возвращаемое значение

YEStrueкогда получатель в настоящее время не синтезирует речь, и текущая речь установлена успешно,NOfalseиначе.Оператор импорта

Objective C

@import AppKit;Swift

import AppKitДоступность

Доступный в OS X v10.3 и позже.

См. также

-

Говорящий уровень синтезатора (слова в минуту).

Объявление

Swift

var rate: FloatObjective C

@property float rateОбсуждение

Диапазон поддерживаемых уровней не предопределен платформой Синтеза речи; но синтезатор может только реагировать на ограниченный диапазон речевых уровней. Средняя человеческая речь происходит на уровне 180 - 220 слов в минуту.

Оператор импорта

Objective C

@import AppKit;Swift

import AppKitДоступность

Доступный в OS X v10.5 и позже.

-

Говорящий объем синтезатора.

Объявление

Swift

var volume: FloatObjective C

@property float volumeОбсуждение

Объемы выражены в модулях с плавающей точкой в пределах от 0,0 до 1,0. Значение 0,0 соответствует тишине, и значение 1,0 соответствует максимальному возможному объему. Единицы объема лежат на масштабе, который линеен с амплитудой или напряжением. Удвоение воспринятой громкости соответствует удвоению объема. Установка значения вне этого диапазона не определена.

Оператор импорта

Objective C

@import AppKit;Swift

import AppKitДоступность

Доступный в OS X v10.5 и позже.

-

Регистрирует данный речевой словарь в получателе.

Объявление

Swift

func addSpeechDictionary(_speechDictionary: [NSObject : AnyObject])Objective C

- (void)addSpeechDictionary:(NSDictionary *)speechDictionaryПараметры

speechDictionaryРечевой словарь для добавления к словарям получателя. Пары ключ/значение перечислены в Речевых Свойствах Словаря.

Обсуждение

Посмотрите обсуждение

UseSpeechDictionaryв менеджере по Синтезу речи Референсе для получения дополнительной информации.Оператор импорта

Objective C

@import AppKit;Swift

import AppKitДоступность

Доступный в OS X v10.5 и позже.

-

Обеспечивает значение свойства получателя.

Объявление

Swift

func objectForProperty(_speechProperty: String, errorout_error: NSErrorPointer) -> AnyObject?Параметры

speechPropertyСвойство для получения.

out_errorНа выводе, ошибка, произошедшая при получении значения

speechProperty.Возвращаемое значение

Значение

speechProperty.Оператор импорта

Objective C

@import AppKit;Swift

import AppKitДоступность

Доступный в OS X v10.5 и позже.

См. также

-

Указывает значение свойства получателя.

Объявление

Swift

func setObject(_object: AnyObject?, forPropertyproperty: String, erroroutError: NSErrorPointer) -> BoolПараметры

speechPropertyСвойство для установки. Поддерживаемые свойства перечислены в Ключах Словаря NSSpeechStatusProperty.

out_errorНа выводе, ошибка, произошедшая при установке

speechProperty.Возвращаемое значение

YEStrueкогдаspeechPropertyбыл установлен.NOfalseкогда была ошибка, указанная вout_error.Оператор импорта

Objective C

@import AppKit;Swift

import AppKitДоступность

Доступный в OS X v10.5 и позже.

См. также

-

Делегат синтезатора.

Объявление

Swift

unowned(unsafe) var delegate: NSSpeechSynthesizerDelegate?Objective C

@property(assign) id< NSSpeechSynthesizerDelegate > delegateОператор импорта

Objective C

@import AppKit;Swift

import AppKitДоступность

Доступный в OS X v10.3 и позже.

-

Обеспечивает идентификаторы речи, доступной в системе.

Объявление

Swift

class func availableVoices() -> [AnyObject]?Objective C

+ (NSArray *)availableVoicesВозвращаемое значение

Массив строк, представляющих идентификаторы каждой речи, доступной в системе.

Оператор импорта

Objective C

@import AppKit;Swift

import AppKitДоступность

Доступный в OS X v10.3 и позже.

См. также

-

Обеспечивает словарь атрибута речи.

Объявление

Objective C

+ (NSDictionary *)attributesForVoice:(NSString *)voiceIdentifierПараметры

voiceIdentifierИдентификатор речи, атрибуты которой Вы хотите получить.

Возвращаемое значение

Словарь атрибута речи, идентифицированной

voiceIdentifier. Ключи атрибутов и типы значения перечислены в Речевых АтрибутахОператор импорта

Objective C

@import AppKit;Swift

import AppKitДоступность

Доступный в OS X v10.3 и позже.

-

Обеспечивает идентификатор речи по умолчанию.

Возвращаемое значение

Идентификатор речи по умолчанию.

Оператор импорта

Objective C

@import AppKit;Swift

import AppKitДоступность

Доступный в OS X v10.3 и позже.

-

Указывает, говорит ли какое-либо приложение в настоящее время через устройство звукового вывода.

Объявление

Swift

class func isAnyApplicationSpeaking() -> BoolObjective C

+ (BOOL)isAnyApplicationSpeakingВозвращаемое значение

YEStrueкогда другое приложение производит речь через устройство звукового вывода,NOfalseиначе.Обсуждение

Вы обычно вызываете этот метод, чтобы препятствовать тому, чтобы Ваше приложение говорило по речи, сгенерированной другим приложением или системным компонентом.

Оператор импорта

Objective C

@import AppKit;Swift

import AppKitДоступность

Доступный в OS X v10.3 и позже.

-

Указывает, генерирует ли получатель в настоящее время синтезированную речь.

Объявление

Swift

var speaking: Bool { get }Objective C

@property(getter=isSpeaking, readonly) BOOL speakingОбсуждение

YEStrueкогда получатель генерирует синтезированную речь,NOfalseиначе.Оператор импорта

Objective C

@import AppKit;Swift

import AppKitДоступность

Доступный в OS X v10.10 и позже.

-

Начинает говорить синтезируемый текст через устройство звукового вывода системы по умолчанию.

Объявление

Swift

func startSpeakingString(_text: String!) -> BoolObjective C

- (BOOL)startSpeakingString:(NSString *)textПараметры

textТекст для разговора. Когда

nilили пустой, никакой синтез не происходит.Возвращаемое значение

YEStrueкогда разговор запускается успешно,NOfalseиначе.Обсуждение

Если получатель в настоящее время говорит синтезированную речь когда

startSpeakingString:вызывается, тот процесс останавливается преждеtextговорится.Когда синтез

textконцы обычно или останавливаются, сообщениеspeechSynthesizer:didFinishSpeaking:отправляется делегату.Оператор импорта

Objective C

@import AppKit;Swift

import AppKitДоступность

Доступный в OS X v10.3 и позже.

-

Начинает синтезировать текст в звук (AIFF) файл.

Объявление

Параметры

textТекст для разговора. Когда

nilили пустой, никакой синтез не запускается.urlРасположение файловой системы выходного звукового файла.

Возвращаемое значение

YEStrueкогда синтез запускается успешно,NOfalseиначе.Обсуждение

Когда синтез

textконцы обычно или останавливаются, сообщениеspeechSynthesizer:didFinishSpeaking:отправляется делегату.Один пример того, как Вы могли бы использовать этот метод, находится в почтовой программе, автоматически преобразовывающей новые сообщения в звуковые файлы, которые могут храниться на iPod для более позднего слушания.

Оператор импорта

Objective C

@import AppKit;Swift

import AppKitДоступность

Доступный в OS X v10.3 и позже.

-

Происходящий синтез пауз на данной границе.

Объявление

Swift

func pauseSpeakingAtBoundary(_boundary: NSSpeechBoundary)Objective C

- (void)pauseSpeakingAtBoundary:(NSSpeechBoundary)boundaryПараметры

boundaryГраница, на которой можно приостановить речь. Поддерживаемые связанные типы перечислены в NSSpeechBoundary.

Обсуждение

Передайте константу

NSSpeechImmediateBoundaryприостановиться сразу, даже посреди слова. ПередачаNSSpeechWordBoundaryилиNSSpeechSentenceBoundaryк речи паузы в конце текущего слова или предложения, соответственно.Можно определить, приостановило ли приложение речевой вывод синтезатора путем получения

NSSpeechStatusPropertyсвойство черезobjectForProperty:error:метод. В то время как синтезатор приостанавливается, речевая информация о статусе указывает этоNSSpeechStatusOutputBusyиNSSpeechStatusOutputPausedобаYEStrue.Если конец строки, на которой говорят, достигнут перед указанной точкой паузы, паузами речевого вывода в конце строки.

Оператор импорта

Objective C

@import AppKit;Swift

import AppKitДоступность

Доступный в OS X v10.5 и позже.

См. также

-

Синтез резюме.

Объявление

Swift

func continueSpeaking()Objective C

- (void)continueSpeakingОбсуждение

В любое время после

pauseSpeakingAtBoundary:вызывается,continueSpeakingможет быть вызван, чтобы продолжать говорить с начала слова, в котором приостановилась речь.Отправка

continueSpeakingк получателю, который в настоящее время не находится в приостановленном состоянии, не имеет никакого эффекта на синтезатор или на будущие вызовы кpauseSpeakingAtBoundary:функция. Если Вы вызываетеcontinueSpeakingна синтезаторе, прежде чем пауза является эффективной,continueSpeakingотменяет паузу.Если

pauseSpeakingAtBoundary:метод остановил речь посреди слова, синтезатор начнет произносить то слово с начала, когда Вы вызоветеcontinueSpeaking.Оператор импорта

Objective C

@import AppKit;Swift

import AppKitДоступность

Доступный в OS X v10.5 и позже.

См. также

-

Происходящий синтез остановок.

Объявление

Swift

func stopSpeaking()Objective C

- (void)stopSpeakingОбсуждение

Если получатель в настоящее время генерирует речь, синтез останавливается, и сообщение

speechSynthesizer:didFinishSpeaking:отправляется делегату.Оператор импорта

Objective C

@import AppKit;Swift

import AppKitДоступность

Доступный в OS X v10.3 и позже.

-

Происходящий синтез остановок на данной границе.

Объявление

Swift

func stopSpeakingAtBoundary(_boundary: NSSpeechBoundary)Objective C

- (void)stopSpeakingAtBoundary:(NSSpeechBoundary)boundaryПараметры

boundaryГраница, на которой можно остановить речь. Поддерживаемые связанные типы перечислены в NSSpeechBoundary.

Обсуждение

Передайте константу

NSSpeechImmediateBoundaryостановиться сразу, даже посреди слова. ПередачаNSSpeechWordBoundaryилиNSSpeechSentenceBoundaryостановить речь в конце текущего слова или предложения, соответственно.Если конец строки, на которой говорят, достигнут перед указанной точкой остановки, остановками синтезатора в конце строки, не генерируя ошибку.

Оператор импорта

Objective C

@import AppKit;Swift

import AppKitДоступность

Доступный в OS X v10.5 и позже.

-

Обеспечивает символы фонемы, сгенерированные данным текстом.

Объявление

Параметры

textТекст, из которого можно генерировать фонемы.

Возвращаемое значение

Фонемы сгенерированы из текста.

Обсуждение

Преобразование текстовых данных в фонетические данные особенно полезно во время разработки приложений, когда Вы могли бы хотеть скорректировать фразы, которые Ваше приложение генерирует для создания более гладкой речи. Первым преобразованием целевой фразы в фонемы Вы видите то, что синтезатор попытается говорить. Тогда Вы должны исправить только роли, которые не игрались бы путем, Вы хотите

Строка, возвращенная phonemesFromText: соответствует точно фонемам, на которых говорили бы, имел входной текст, отправленный в

startSpeakingString:вместо этого. Все текущие настройки свойства для синтезатора применяются к преобразованной речи.Никакие методы делегата не вызывают в то время как

phonemesFromText:метод генерирует свой вывод.Оператор импорта

Objective C

@import AppKit;Swift

import AppKitДоступность

Доступный в OS X v10.5 и позже.

-

Следующие константы являются ключами для словаря, возвращенного

attributesForVoice:.Объявление

Swift

let NSVoiceIdentifier: NSString! let NSVoiceName: NSString! let NSVoiceAge: NSString! let NSVoiceGender: NSString! let NSVoiceDemoText: NSString! let NSVoiceLocaleIdentifier: NSString! let NSVoiceSupportedCharacters: NSString! let NSVoiceIndividuallySpokenCharacters: NSString!Objective C

NSString *const NSVoiceIdentifier; NSString *const NSVoiceName; NSString *const NSVoiceAge; NSString *const NSVoiceGender; NSString *const NSVoiceDemoText; NSString *const NSVoiceLanguage; NSString *const NSVoiceLocaleIdentifier; NSString *const NSVoiceSupportedCharacters; NSString *const NSVoiceIndividuallySpokenCharacters;Константы

-

NSVoiceIdentifierNSVoiceIdentifierУникальная строка, идентифицирующая речь. Идентификаторы системной речи перечислены в Перечислении 1.

Доступный в OS X v10.3 и позже.

-

NSVoiceNameNSVoiceNameИмя речи, подходящей для дисплея.

NSString.Доступный в OS X v10.3 и позже.

-

NSVoiceAgeNSVoiceAgeВоспринятый возраст (в годах) речи.

NSStringДоступный в OS X v10.3 и позже.

-

NSVoiceGenderNSVoiceGenderВоспринятый род речи. Поддерживаемые значения перечислены в Речевых Родах.

NSStringДоступный в OS X v10.3 и позже.

-

NSVoiceDemoTextNSVoiceDemoTextДемонстрационная строка для разговора.

NSStringДоступный в OS X v10.3 и позже.

-

NSVoiceLanguageNSVoiceLanguageЯзык речи (в настоящее время только английский язык США).

NSStringОсуждаемый: использовать

NSVoiceLocaleIdentifierвместо этого.Доступный в OS X v10.0 и позже.

Осуждаемый в OS X v10.5.

-

NSVoiceLocaleIdentifierNSVoiceLocaleIdentifierЯзык речи.

NSStringКаноническая строка идентификатора локали, описывающая локаль речи. Локаль обычно составляется из трех частей упорядоченной информации: код языка, код области и различный код. Обратитесь к документации о

NSLocaleкласс или Руководство по Интернационализации и Локализации для получения дополнительной информации.Доступный в OS X v10.5 и позже.

-

NSVoiceSupportedCharactersNSVoiceSupportedCharactersСписок unicode символьных диапазонов ID, определяющих unicode символы, поддерживаемые этой речью. словарь, содержащий два ключа: «UnicodeCharBegin», целочисленное значение, содержащее начало unicode ID этого диапазона; и «UnicodeCharBegin», целочисленное значение, содержащее окончание unicode ID этого диапазона. Синтезатор преобразует или проигнорирует любые символы, не содержавшиеся в диапазоне поддерживаемых символов.

Некоторая речь может не обеспечить этот атрибут.

Доступный в OS X v10.5 и позже.

-

NSVoiceIndividuallySpokenCharactersNSVoiceIndividuallySpokenCharactersСписок unicode символьных диапазонов ID, определяющих unicode символы, на которых может говорить в познаковом режиме эта речь. запись списка ach является словарем, содержащим два ключа: «UnicodeCharBegin», целочисленное значение, содержащее начало unicode ID этого диапазона; и «UnicodeCharBegin», целочисленное значение, содержащее окончание unicode ID этого диапазона.

Эти диапазоны могут использоваться Вашим приложением, чтобы определить, может ли речь говорить имя отдельного символа, когда говорится в познаковом режиме.

Некоторая речь может не обеспечить этот атрибут.

Доступный в OS X v10.5 и позже.

Обсуждение

Перечисление 1 перечисляет идентификаторы системной речи (определенный в

/System/Library/Speech/Voices):Перечисление 1Identifiers системной речи OS X com.apple.speech.synthesis.voice.Agnescom.apple.speech.synthesis.voice.Albertcom.apple.speech.synthesis.voice.Alexcom.apple.speech.synthesis.voice.BadNewscom.apple.speech.synthesis.voice.Bahhcom.apple.speech.synthesis.voice.Bellscom.apple.speech.synthesis.voice.Boingcom.apple.speech.synthesis.voice.Brucecom.apple.speech.synthesis.voice.Bubblescom.apple.speech.synthesis.voice.Celloscom.apple.speech.synthesis.voice.Derangedcom.apple.speech.synthesis.voice.Fredcom.apple.speech.synthesis.voice.GoodNewscom.apple.speech.synthesis.voice.Hystericalcom.apple.speech.synthesis.voice.Juniorcom.apple.speech.synthesis.voice.Kathycom.apple.speech.synthesis.voice.Organcom.apple.speech.synthesis.voice.Princesscom.apple.speech.synthesis.voice.Ralphcom.apple.speech.synthesis.voice.Trinoidscom.apple.speech.synthesis.voice.Vickicom.apple.speech.synthesis.voice.Victoriacom.apple.speech.synthesis.voice.Whispercom.apple.speech.synthesis.voice.Zarvox

-

-

Следующие константы определяют речевые атрибуты рода, которые являются допустимыми значениями

NSVoiceGenderключ, возвращенныйattributesForVoice:.Объявление

Swift

let NSVoiceGenderNeuter: NSString! let NSVoiceGenderMale: NSString! let NSVoiceGenderFemale: NSString!Objective C

NSString *const NSVoiceGenderNeuter; NSString *const NSVoiceGenderMale; NSString *const NSVoiceGenderFemale;Константы

-

NSVoiceGenderNeuterNSVoiceGenderNeuterНейтральная речь (или речь новинки с юмористическим или причудливым качеством).

Доступный в OS X v10.3 и позже.

-

NSVoiceGenderMaleNSVoiceGenderMaleМужской голос

Доступный в OS X v10.3 и позже.

-

NSVoiceGenderFemaleNSVoiceGenderFemaleРозеточная речь

Доступный в OS X v10.3 и позже.

-

-

Эти константы используются с

setObject:forProperty:error:иobjectForProperty:error:получить или установить характеристики синтезатора.Объявление

Swift

let NSSpeechStatusProperty: NSString! let NSSpeechErrorsProperty: NSString! let NSSpeechInputModeProperty: NSString! let NSSpeechCharacterModeProperty: NSString! let NSSpeechNumberModeProperty: NSString! let NSSpeechRateProperty: NSString! let NSSpeechPitchBaseProperty: NSString! let NSSpeechPitchModProperty: NSString! let NSSpeechVolumeProperty: NSString! let NSSpeechSynthesizerInfoProperty: NSString! let NSSpeechRecentSyncProperty: NSString! let NSSpeechPhonemeSymbolsProperty: NSString! let NSSpeechCurrentVoiceProperty: NSString! let NSSpeechCommandDelimiterProperty: NSString! let NSSpeechResetProperty: NSString! let NSSpeechOutputToFileURLProperty: NSString!Objective C

NSString *const NSSpeechStatusProperty; NSString *const NSSpeechErrorsProperty; NSString *const NSSpeechInputModeProperty; NSString *const NSSpeechCharacterModeProperty; NSString *const NSSpeechNumberModeProperty; NSString *const NSSpeechRateProperty; NSString *const NSSpeechPitchBaseProperty; NSString *const NSSpeechPitchModProperty; NSString *const NSSpeechVolumeProperty; NSString *const NSSpeechSynthesizerInfoProperty; NSString *const NSSpeechRecentSyncProperty; NSString *const NSSpeechPhonemeSymbolsProperty; NSString *const NSSpeechCurrentVoiceProperty; NSString *const NSSpeechCommandDelimiterProperty; NSString *const NSSpeechResetProperty; NSString *const NSSpeechOutputToFileURLProperty;Константы

-

NSSpeechStatusPropertyNSSpeechStatusPropertyПолучите речевую информацию о статусе для синтезатора.

NSDictionaryэто содержит речевую информацию о статусе для синтезатора. Посмотрите Ключи Словаря NSSpeechStatusProperty для описания ключевого настоящего в словаре.Это свойство используется с

setObject:forProperty:error:.Доступный в OS X v10.5 и позже.

-

NSSpeechErrorsPropertyNSSpeechErrorsPropertyПолучите информацию речевой ошибки для синтезатора.

NSDictionaryобъект, содержащий информацию о речевой ошибке. Посмотрите Ключи Словаря NSSpeechErrorProperty для описания ключевого настоящего в словаре.Это свойство позволяет Вам получить информацию о различных ошибках периода выполнения, происходящих во время разговора, такого как обнаружение плохо сформированных встроенных команд. Об ошибках, возвращенных непосредственно менеджером по Синтезу речи, не сообщают здесь.

Если Ваше приложение реализует

speechSynthesizer:didEncounterErrorAtIndex:ofString:message:делегируйте сообщение, сообщение делегата может использовать это свойство для получения ошибочной информации.Это свойство используется с

setObject:forProperty:error:.Доступный в OS X v10.5 и позже.

-

NSSpeechInputModePropertyNSSpeechInputModePropertyПолучите или установите текущий относящийся к обработке текстов режим синтезатора.

NSStringобъект, указывающий, является ли канал в настоящее время в режиме ввода фонемы или режиме ввода текста. Поддерживаемые значения перечислены в Разговоре Режимов для NSSpeechInputModeProperty.Когда в обрабатывающем фонему режиме, текстовая строка интерпретируется, чтобы быть серией символов, представляющих различные фонемы и просодические средства управления. Некоторые синтезаторы могли бы поддерживать дополнительные обрабатывающие ввод режимы и определить константы для этих режимов.

Это свойство используется с

setObject:forProperty:error:иobjectForProperty:error:.Доступный в OS X v10.5 и позже.

-

NSSpeechCharacterModePropertyNSSpeechCharacterModePropertyПолучите или установите текущий относящийся к обработке текстов режим синтезатора.

NSStringобъект, указывающий, является ли канал в настоящее время в режиме ввода фонемы или режиме ввода текста. Поддерживаемые значения перечислены в Разговоре Режимов для NSSpeechInputModeProperty.Когда обрабатывающий символ режим

NSSpeechModeNormal, на вводимых символах говорят, поскольку Вы ожидали бы слышать их. Когда режимNSSpeechModeLiteral, на каждом символе говорят буквально, так, чтобы было произнесено слово «кошка» “C–A–T”.Это свойство используется с

setObject:forProperty:error:иobjectForProperty:error:.Доступный в OS X v10.5 и позже.

-

NSSpeechNumberModePropertyNSSpeechNumberModePropertyПолучите или установите текущий обрабатывающий число режим синтезатора.

NSStringобъект, указывающий, является ли синтезатор в настоящее время в нормальном или литеральном обрабатывающем число режиме. КонстантыNSSpeechModeNormalиNSSpeechModeLiteralвозможные значения этой строки.Когда обрабатывающий число режим

NSSpeechModeNormal, синтезатор собирает цифры в числа (так, чтобы «12» говорился как «двенадцать»). Когда режимNSSpeechModeLiteral, на каждой цифре говорят буквально (так, чтобы «12» говорился как “один, два”).Это свойство используется с

setObject:forProperty:error:иobjectForProperty:error:.Доступный в OS X v10.5 и позже.

-

NSSpeechRatePropertyNSSpeechRatePropertyПолучите или установите речевой уровень синтезатора. Объект NSNumber, указывающий говорящий уровень синтезатора.

Диапазон поддерживаемых уровней не предопределен классом NSSpeechSynthesizer; каждый синтезатор речи обеспечивает свой собственный диапазон речевых уровней. Средняя человеческая речь происходит на уровне 180 - 220 слов в минуту.

Это свойство используется с

setObject:forProperty:error:иobjectForProperty:error:.Доступный в OS X v10.5 и позже.

-

NSSpeechPitchBasePropertyNSSpeechPitchBasePropertyПолучите или установите базовую речевую подачу синтезатора.

NSNumberобъект, указывающий базовую речевую подачу.Типичные частоты речевого диапазона располагаются приблизительно от 90 герц для низкого мужского голоса к, возможно, 300 герц для речи высокого дочернего элемента. Эти частоты соответствуют приблизительным значениям подачи в диапазонах 30 000 - 40 000 и 55 000 - 65 000, соответственно.

Это свойство используется с

setObject:forProperty:error:иobjectForProperty:error:.Доступный в OS X v10.5 и позже.

-

NSSpeechPitchModPropertyNSSpeechPitchModPropertyПолучите или установите модуляцию подачи синтезатора.

NSNumberобъект, указывающий модуляцию подачи синтезатора.Модуляция подачи также выражена как значение с плавающей точкой в диапазоне 0.000 к 127 000. Эти значения соответствуют длительности нот MIDI, где 60.000 равно середине C в масштабе фортепьяно. Самая полезная речь передает падение диапазона 40 000 - 55 000. Значение модуляции подачи 0.000 соответствует монотонности, в которой вся речь сгенерирована в частоте, соответствующей речевой подаче. Учитывая речевое значение подачи 46 000, модуляция подачи 2 000 означала бы, что самый широкий диапазон передач, соответствующих фактической частоте сгенерированного текста, будет 44 000 - 48 000.

Это свойство используется с

setObject:forProperty:error:иobjectForProperty:error:.Доступный в OS X v10.5 и позже.

-

NSSpeechVolumePropertyNSSpeechVolumePropertyПолучите или установите динамический диапазон речевых сигналов для синтезатора.

NSNumberэто указывает динамический диапазон речевых сигналов синтезатора.Объемы выражены в значениях с плавающей точкой в пределах от 0,0 до 1,0. Значение 0,0 соответствует тишине, и значение 1,0 соответствует максимальному возможному объему. Единицы объема лежат на масштабе, который линеен с амплитудой или напряжением. Удвоение воспринятой громкости соответствует удвоению объема.

Это свойство используется с

setObject:forProperty:error:иobjectForProperty:error:.Доступный в OS X v10.5 и позже.

-

NSSpeechSynthesizerInfoPropertyNSSpeechSynthesizerInfoPropertyПолучите информацию о синтезаторе речи, используемом на указанном синтезаторе.

NSDictionaryобъект, содержащий информацию о синтезаторе речи, используемом на указанном синтезаторе. Посмотрите Ключи Свойства Синтезатора речи для описания ключевого настоящего в словаре.Доступный в OS X v10.5 и позже.

-

NSSpeechRecentSyncPropertyNSSpeechRecentSyncPropertyПолучите код сообщения для команды синхронизации, с которой последний раз встречаются.

NSNumberобъект, указывающий команду синхронизации, с которой последний раз встречаются.Это свойство работает с

setObject:forProperty:error:.Доступный в OS X v10.5 и позже.

-

NSSpeechPhonemeSymbolsPropertyNSSpeechPhonemeSymbolsPropertyПолучите список символов фонемы и слов в качестве примера, определенных для синтезатора.

NSDictionaryобъект, содержащий символы фонемы и слова в качестве примера, определенные для текущего синтезатораВаше приложение могло бы использовать эту информацию, чтобы показать пользователю что символы использовать при введении фонематического текста непосредственно. Посмотрите Ключи Словаря NSSpeechPhonemeSymbolsProperty для описания ключевого настоящего в словаре.

Это свойство работает с

setObject:forProperty:error:.Доступный в OS X v10.5 и позже.

-

NSSpeechCurrentVoicePropertyNSSpeechCurrentVoicePropertyУстановите текущую речь на синтезаторе к указанной речи.

NSDictionaryобъект, содержащий символы фонемы и слова в качестве примера, определенные для текущего синтезатора.Ваше приложение могло бы использовать эту информацию, чтобы показать пользователю что символы использовать при введении фонематического текста непосредственно. Посмотрите Ключи Словаря NSSpeechPhonemeSymbolsProperty для ключей, которые можно использовать для указания значений в этом словаре.

Это свойство работает с

setObject:forProperty:error:.Доступный в OS X v10.5 и позже.

-

NSSpeechCommandDelimiterPropertyNSSpeechCommandDelimiterPropertyУстановите встроенные речевые символы-разделители команды, которые будут использоваться для синтезатора.

NSDictionaryобъект, содержащий информацию о разделителе. См. “Ключи Разделителя Команды” для ключей, которые можно использовать для указания значений в этом словаре.По умолчанию вводный разделитель “[[” и заключительный разделитель “]]”. Ваше приложение, возможно, должно было бы изменить эти разделители временно, если те последовательности символов происходят естественно в текстовом буфере, на котором нужно говорить. Ваше приложение может также отключить встроенную обработку команды передающими пустыми разделителями (как пустые строки). Посмотрите Речевой Разделитель Команды для ключей, которые можно использовать для указания значений в этом словаре.

Это свойство работает с

setObject:forProperty:error:.Доступный в OS X v10.5 и позже.

-

NSSpeechResetPropertyNSSpeechResetPropertyЗадержите синтезатор к его состоянию по умолчанию. Нет никакого значения, связанного с этим свойством; для сброса канала к его состоянию по умолчанию установите ключ к

NULL.Можно использовать эту функцию для, например, подача заранее составленной речи и речевой уровень к значениям по умолчанию.

Это свойство работает с

setObject:forProperty:error:.Доступный в OS X v10.5 и позже.

-

NSSpeechOutputToFileURLPropertyNSSpeechOutputToFileURLPropertyУстановите место назначения речевого вывода в файл или динамикам компьютера.

NSURLобъект. Для записи речевого вывода в файл используйте NSURL файла; для генерации звука через динамики компьютера использоватьNULL.Это свойство работает с

setObject:forProperty:error:.Доступный в OS X v10.5 и позже.

-

-

Эти константы идентифицируют режимы ввода, используются с

NSSpeechInputModeProperty.Объявление

Objective C

NSString *const NSSpeechModeText; NSString *const NSSpeechModePhoneme;Константы

-

NSSpeechModeTextNSSpeechModeTextУказывает, что синтезатор находится в относящемся к обработке текстов режиме.

Доступный в OS X v10.5 и позже.

-

NSSpeechModePhonemeNSSpeechModePhonemeУказывает, что синтезатор находится в обрабатывающем фонему режиме. Когда в обрабатывающем фонему режиме, текстовый буфер интерпретируется, чтобы быть серией символов, представляющих различные фонемы и просодические средства управления.

Доступный в OS X v10.5 и позже.

-

-

Эти константы определяют доступные относящиеся к обработке текстов и обрабатывающие число режимы для синтезатора. Эти ключи используются с

NSSpeechInputModePropertyиNSSpeechNumberModeProperty)Объявление

Objective C

NSString *const NSSpeechModeNormal; NSString *const NSSpeechModeLiteral;Константы

-

NSSpeechModeNormalNSSpeechModeNormalУказывает, что синтезатор собирает цифры в числа (так, чтобы 12 говорился как «двенадцать»), и текст в слова.

Доступный в OS X v10.5 и позже.

-

NSSpeechModeLiteralNSSpeechModeLiteralУказывает, что на каждой цифре или символе говорят буквально (так, чтобы 12 говорился как «один, два», или слово «кошка» произнесено как «C T»).

Доступный в OS X v10.5 и позже.

-

-

Эти константы идентифицируют речевые ключи состояния, используемые с

NSSpeechStatusProperty.Объявление

Swift

let NSSpeechStatusOutputBusy: NSString! let NSSpeechStatusOutputPaused: NSString! let NSSpeechStatusNumberOfCharactersLeft: NSString! let NSSpeechStatusPhonemeCode: NSString!Objective C

NSString *const NSSpeechStatusOutputBusy; NSString *const NSSpeechStatusOutputPaused; NSString *const NSSpeechStatusNumberOfCharactersLeft; NSString *const NSSpeechStatusPhonemeCode;Константы

-

NSSpeechStatusOutputBusyNSSpeechStatusOutputBusyУказывает, производит ли синтезатор в настоящее время речь.

Когда никакие аудиоданные не производятся через динамик компьютера, синтезатор считается, производя речь даже в несколько раз. Это происходит, например, когда синтезатор обрабатывает ввод, но еще не инициировал речь или когда приостанавливается речевой вывод.

Доступный в OS X v10.5 и позже.

-

NSSpeechStatusOutputPausedNSSpeechStatusOutputPausedУказывает, был ли речевой вывод в синтезаторе приостановлен путем отправки сообщения

pauseSpeakingAtBoundary:.Доступный в OS X v10.5 и позже.

-

NSSpeechStatusNumberOfCharactersLeftNSSpeechStatusNumberOfCharactersLeftЧисло символов уехало во входной строке текста.

Когда значение этого ключа является нулем, можно уничтожить входную строку.

Доступный в OS X v10.5 и позже.

-

NSSpeechStatusPhonemeCodeNSSpeechStatusPhonemeCodeУказывает, что синтезатор находится в обрабатывающем фонему режиме. Когда в обрабатывающем фонему режиме, текстовый буфер интерпретируется, чтобы быть серией символов, представляющих различные фонемы и просодические средства управления.

Доступный в OS X v10.5 и позже.

-

-

Эти ключевые константы идентифицируют ошибки, которые могут произойти во время синтеза речи. Они используются с

NSSpeechErrorsProperty.Объявление

Swift

let NSSpeechErrorCount: NSString! let NSSpeechErrorOldestCode: NSString! let NSSpeechErrorOldestCharacterOffset: NSString! let NSSpeechErrorNewestCode: NSString! let NSSpeechErrorNewestCharacterOffset: NSString!Objective C

NSString *const NSSpeechErrorCount; NSString *const NSSpeechErrorOldestCode; NSString *const NSSpeechErrorOldestCharacterOffset; NSString *const NSSpeechErrorNewestCode; NSString *const NSSpeechErrorNewestCharacterOffset;Константы

-

NSSpeechErrorCountNSSpeechErrorCountЧисло ошибок, произошедших в обработке строки текущего текста, начиная с последней возможности к

objectForProperty:error:сNSSpeechErrorsPropertyсвойство.NSNumberИспользуя

NSSpeechErrorOldestCodeключи иNSSpeechErrorNewestCodeключи, можно получить информацию о самых старых и новых ошибках, произошедших начиная с последней возможности сobjectForProperty:error:, но Вы не можете получить информацию ни о каких прошедших ошибках.Доступный в OS X v10.5 и позже.

-

NSSpeechErrorOldestCodeNSSpeechErrorOldestCodeКод ошибки первой ошибки, произошедшей начиная с последней возможности с

objectForProperty:error:сNSSpeechErrorsPropertyсвойство.NSNumberДоступный в OS X v10.5 и позже.

-

NSSpeechErrorOldestCharacterOffsetNSSpeechErrorOldestCharacterOffsetПозиция в текстовой строке первой ошибки, произошедшей начиная с последней возможности с

objectForProperty:error:сNSSpeechErrorsPropertyсвойство.NSNumberДоступный в OS X v10.5 и позже.

-

NSSpeechErrorNewestCodeNSSpeechErrorNewestCodeКод ошибки новой ошибки, произошедшей начиная с последней возможности с

objectForProperty:error:сNSSpeechErrorsPropertyсвойство.NSNumberДоступный в OS X v10.5 и позже.

-

NSSpeechErrorNewestCharacterOffsetNSSpeechErrorNewestCharacterOffsetПозиция в текстовой строке новой ошибки, произошедшей начиная с последней возможности с

objectForProperty:error:сNSSpeechErrorsPropertyсвойство.NSNumber.Доступный в OS X v10.5 и позже.

-

-

Эти константы являются ключами, используемыми в словаре NSSpeechSynthesizerInfoProperty.

Объявление

Swift

let NSSpeechSynthesizerInfoIdentifier: NSString! let NSSpeechSynthesizerInfoVersion: NSString!Objective C

NSString *const NSSpeechSynthesizerInfoIdentifier; NSString *const NSSpeechSynthesizerInfoVersion;Константы

-

Эти константы являются ключами, используемыми в словаре NSSpeechPhonemeSymbolsProperty.

Объявление

Swift

let NSSpeechPhonemeInfoOpcode: NSString! let NSSpeechPhonemeInfoSymbol: NSString! let NSSpeechPhonemeInfoExample: NSString! let NSSpeechPhonemeInfoHiliteStart: NSString! let NSSpeechPhonemeInfoHiliteEnd: NSString!Objective C

NSString *const NSSpeechPhonemeInfoOpcode NSString *const NSSpeechPhonemeInfoSymbol; NSString *const NSSpeechPhonemeInfoExample; NSString *const NSSpeechPhonemeInfoHiliteStart; NSString *const NSSpeechPhonemeInfoHiliteEnd;Константы

-

NSSpeechPhonemeInfoOpcodeNSSpeechPhonemeInfoOpcodeNSNumber

Доступный в OS X v10.5 и позже.

-

NSSpeechPhonemeInfoSymbolNSSpeechPhonemeInfoSymbolСимвол раньше представлял фонему.

Символ не обязательно имеет фонетическое соединение с фонемой, но мог бы просто быть абстрактным текстовым представлением ее.

Доступный в OS X v10.5 и позже.

-

NSSpeechPhonemeInfoExampleNSSpeechPhonemeInfoExampleСлово в качестве примера, иллюстрирующее использование фонемы.

Доступный в OS X v10.5 и позже.

-

NSSpeechPhonemeInfoHiliteStartNSSpeechPhonemeInfoHiliteStartСимвольное смещение в слово в качестве примера, идентифицирующее расположение начала фонемы.

Доступный в OS X v10.5 и позже.

-

NSSpeechPhonemeInfoHiliteEndNSSpeechPhonemeInfoHiliteEndСимвольное смещение в слово в качестве примера, идентифицирующее расположение конца фонемы.

Доступный в OS X v10.5 и позже.

-

-

Эти ключи разделителей речевой команды констант, используемые в

NSSpeechCommandDelimiterProperty.Объявление

Objective C

NSString *const NSSpeechCommandPrefix; NSString *const NSSpeechCommandSuffix;Константы

-

NSSpeechCommandPrefixNSSpeechCommandPrefixРазделитель команды представляет это в виде строки префиксы команда, по умолчанию, это

[[.Доступный в OS X v10.5 и позже.

-

NSSpeechCommandSuffixNSSpeechCommandSuffixРазделитель команды представляет это в виде строки суффиксы команда, по умолчанию, это

]].Доступный в OS X v10.5 и позже.

-

-

Эти константы идентифицируют пары ключ/значение, используемые для добавления словаря к использованию словаря

addSpeechDictionary:.Объявление

Swift

let NSSpeechDictionaryLocaleIdentifier: NSString! let NSSpeechDictionaryModificationDate: NSString! let NSSpeechDictionaryPronunciations: NSString! let NSSpeechDictionaryAbbreviations: NSString! let NSSpeechDictionaryEntrySpelling: NSString! let NSSpeechDictionaryEntryPhonemes: NSString!Objective C

NSString *const NSSpeechDictionaryLocaleIdentifier; NSString *const NSSpeechDictionaryModificationDate; NSString *const NSSpeechDictionaryPronunciations; NSString *const NSSpeechDictionaryAbbreviations; NSString *const NSSpeechDictionaryEntrySpelling; NSString *const NSSpeechDictionaryEntryPhonemes;Константы

-

NSSpeechDictionaryLocaleIdentifierNSSpeechDictionaryLocaleIdentifierКаноническая строка идентификатора локали, описывающая локаль словаря. Локаль обычно составляется из трех частей упорядоченной информации: код языка, код области и различный код. Обратитесь к документации о

NSLocaleили Руководство по Интернационализации и Локализации для получения дополнительной информацииДоступный в OS X v10.5 и позже.

-

NSSpeechDictionaryModificationDateNSSpeechDictionaryModificationDateСтроковое представление даты последнего изменения словаря в международном формате (YYYY-MM-DD HH:MM:SS ±HHMM). Если то же слово появится через многократные словари, то тот из словаря с новой датой будет использоваться.

Доступный в OS X v10.5 и позже.

-

NSSpeechDictionaryPronunciationsNSSpeechDictionaryPronunciationsМассив объектов словаря, содержащих ключи

NSSpeechDictionaryEntrySpellingиNSSpeechDictionaryEntryPhonemes.Доступный в OS X v10.5 и позже.

-

NSSpeechDictionaryAbbreviationsNSSpeechDictionaryAbbreviationsМассив объектов словаря, содержащих ключи

NSSpeechDictionaryEntrySpellingиNSSpeechDictionaryEntryPhonemes.Доступный в OS X v10.5 и позже.

-

NSSpeechDictionaryEntrySpellingNSSpeechDictionaryEntrySpellingНаписание записи.

NSString.Доступный в OS X v10.5 и позже.

-

NSSpeechDictionaryEntryPhonemesNSSpeechDictionaryEntryPhonemesФонематическое представление записи.

NSString.Доступный в OS X v10.5 и позже.

-

-

Эти константы используются для указания, где речь должна быть остановлена и приостановлена. Посмотрите

pauseSpeakingAtBoundary:иstopSpeakingAtBoundary:.Объявление

Swift

enum NSSpeechBoundary : UInt { case ImmediateBoundary case WordBoundary case SentenceBoundary }Objective C

enum { NSSpeechImmediateBoundary = 0, NSSpeechWordBoundary, NSSpeechSentenceBoundary }; typedef NSUInteger NSSpeechBoundary;Константы

-

ImmediateBoundaryNSSpeechImmediateBoundaryРечь должна быть приостановлена или сразу остановлена.

Доступный в OS X v10.5 и позже.

-

WordBoundaryNSSpeechWordBoundaryРечь должна быть приостановлена или остановлена в конце слова.

Доступный в OS X v10.5 и позже.

-

SentenceBoundaryNSSpeechSentenceBoundaryРечь должна быть приостановлена или остановлена в конце предложения.

Доступный в OS X v10.5 и позже.

Оператор импорта

Objective C

@import AppKit;Swift

import AppKitДоступность

Доступный в OS X v10.5 и позже.

-